Avis | Internet est en panne – mais il n’est pas trop tard pour l’améliorer

(Shutterstock)

(Shutterstock)Partout, les signes indiquent qu’Internet se détériore. Prenons quelques exemples récents :

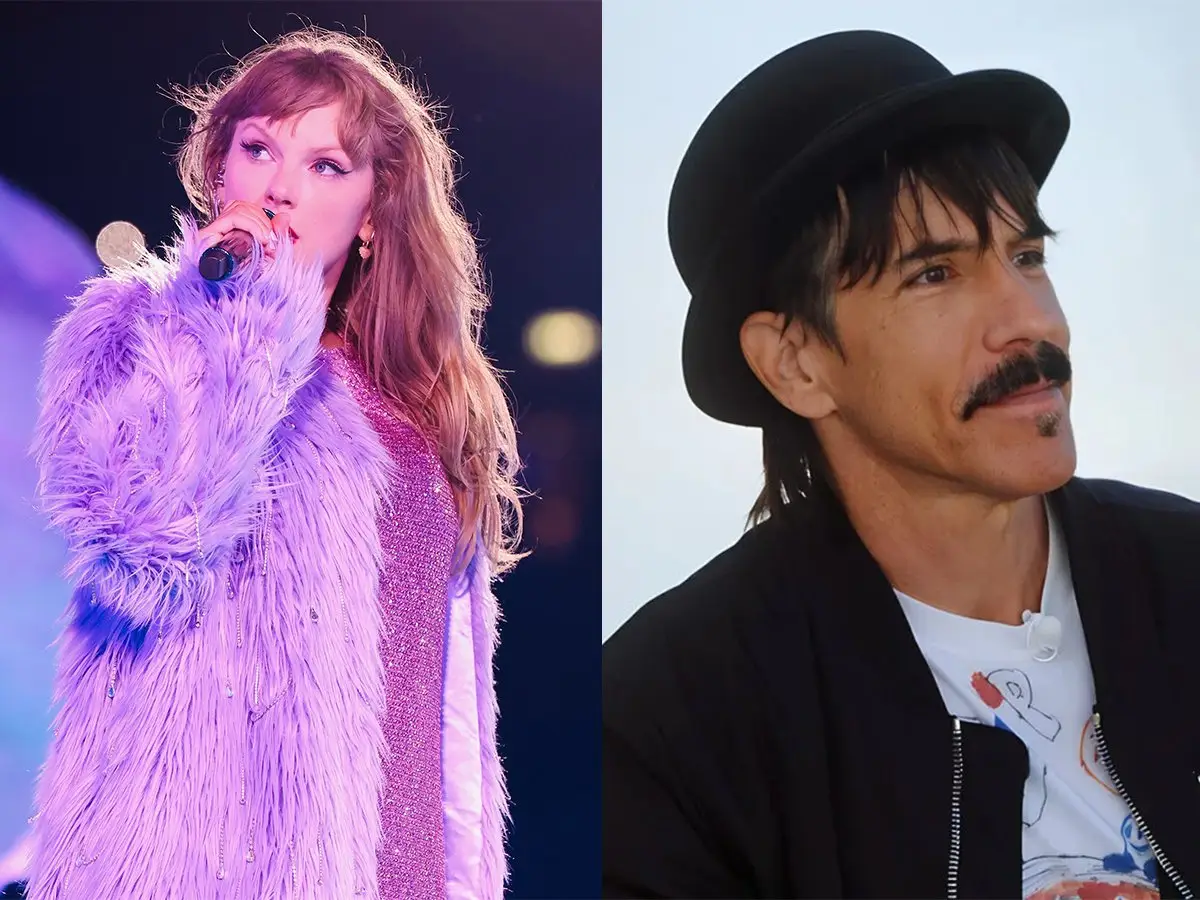

Oprah Winfrey averti fans qu'elle ne vendait pas de sel rose ou de bonbons amaigrissants sur Internet et qu'elle n'avait pas non plus bloqué les évacués du tsunami d'une voie d'évacuation près de sa propriété à Hawaï. Au-delà de moi, c'est partout, dit-elle. Une amie a reçu un message désespéré soi-disant de son fils – il s’avère que ce n’était pas le cas. Une autre amie a entendu ce qui ressemblait exactement à la voix de sa fille demandant de l’argent. Ce n’était pas sa fille, c’était AI.

patricia azarcoya schneider

Au Minnesota, l'évêque catholique romain Robert Barron a déclaré à ses disciples via YouTube qu'il n'avait en réalité pas été convoqué à Rome (vraisemblablement pour des raisons de discipline) et qu'il ne donnait pas non plus de conseils sur la façon d'éliminer les démons des toilettes. Ces fausses affirmations ont été partagées via une vidéo générée par l’IA. Ce sont des fraudeurs, a déclaré Barron. Ce qu’ils font, c’est gagner de l’argent avec ces choses parce qu’ils les monétisent grâce à la publicité.

Dans le New Jersey, les proches en deuil d'un retraité de 76 ans dit Reuters comment il avait été invité à New York par un chatbot IA séduisant nommé Big sis Billie – un chatbot Meta qui prétendait que c'était réel et voulait le rencontrer. Se précipitant pour attraper un train, il est tombé et s'est cogné la tête. Il est décédé trois jours plus tard.

J’ai observé ces tendances de près en tant que directeur de l’International Fact-Checking Network, un groupe qui encourage le journalisme de vérification des faits dans le monde entier, et je constate la peur croissante du public que tout ce qu’il voit sur Internet est faux et que les marqueurs démodés d’exactitude et d’authenticité disparaissent.

Mais aussi grave que cela puisse être, il y a encore de l’espoir : des gens sérieux continuent de documenter les problèmes et de chercher des solutions, depuis des vérificateurs de faits décousus jusqu’à des universitaires accrédités et des membres du Congrès. Nous n’avons pas à laisser Internet sombrer dans les griffes des fraudeurs, des escrocs et des campagnes de propagande. Il existe de plus en plus de signes d’un terrain d’entente permettant aux gens de riposter.

La façon dont nous sommes arrivés ici mérite un examen. Depuis le début des années 2000, une poignée d’énormes entreprises basées aux États-Unis sont parvenues à dominer l’Internet actuel : Meta Google X Apple Amazon Microsoft et OpenAI. Il n’y a pas si longtemps, les plateformes ont régulièrement empêché la fraude de se déchaîner face à une mauvaise publicité et à l’indignation du public grâce à une variété d’outils et de politiques de modération.

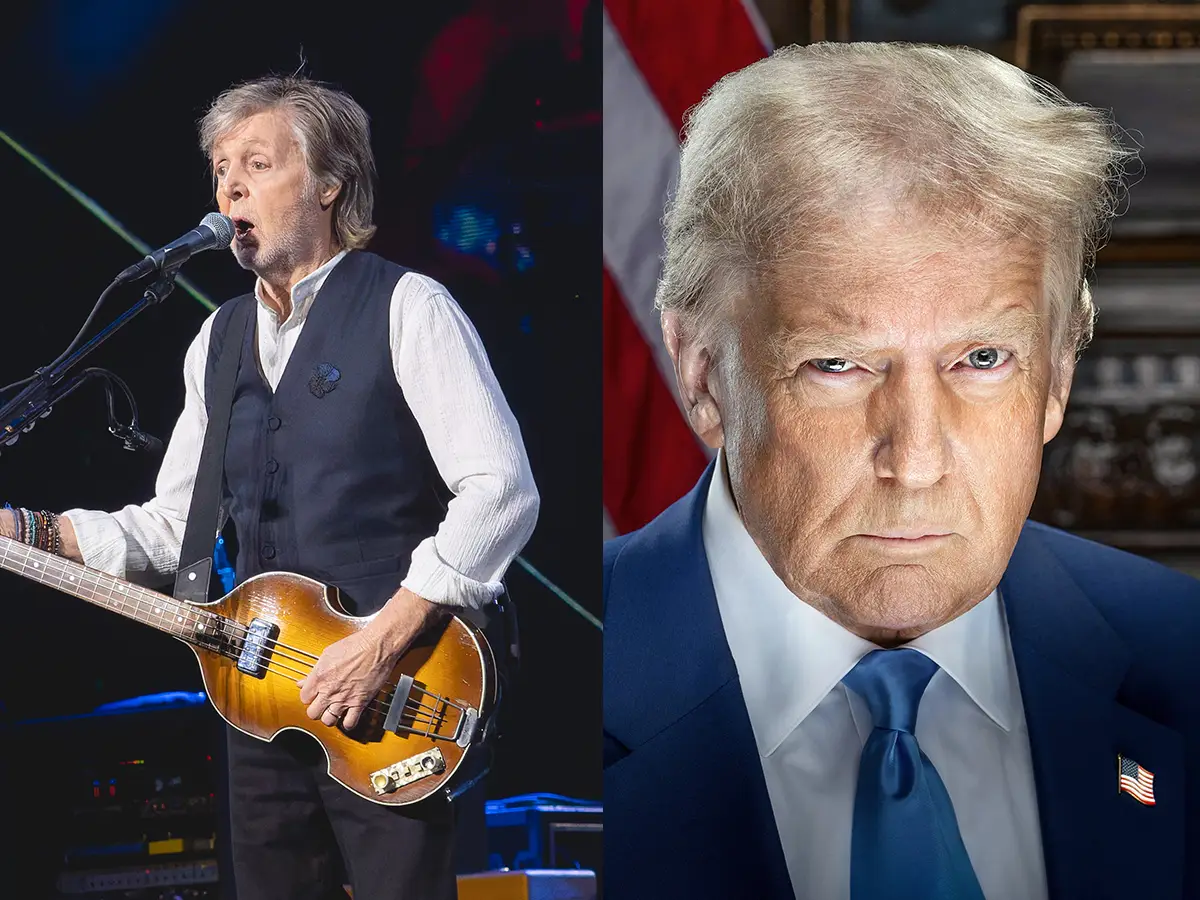

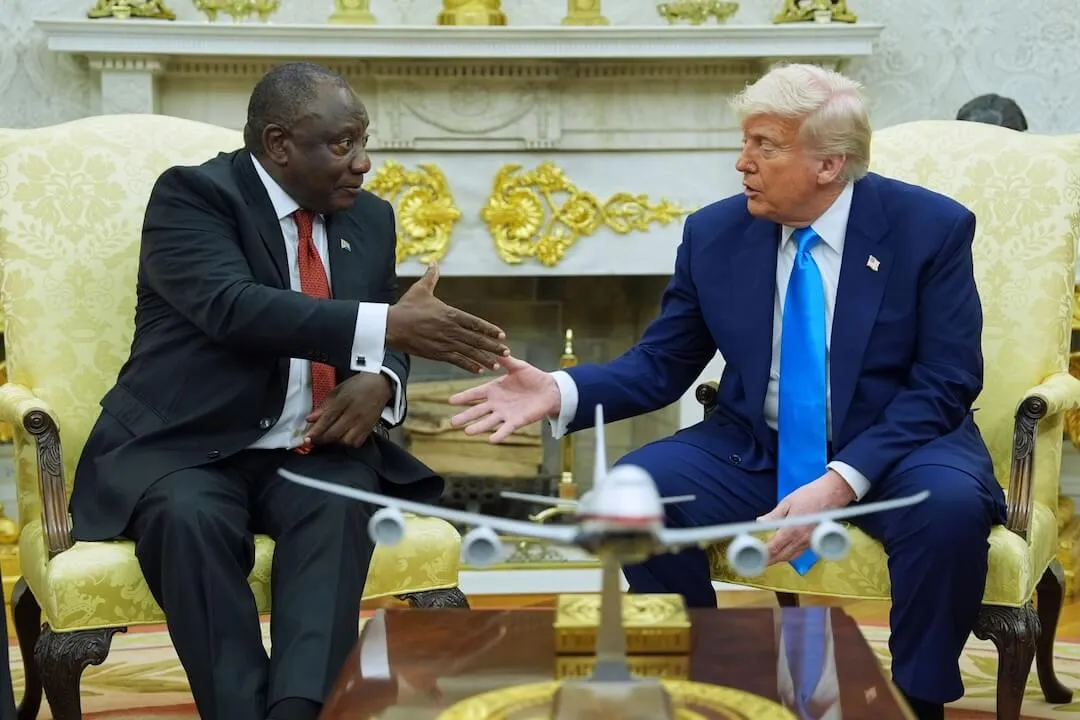

L’environnement a radicalement changé après l’élection du président Donald Trump. Alors que Trump et ses alliés exprimaient leur pression pour lutter contre la censure, les plateformes reconsidéraient déjà les coûts de modération et l’exposition. Plus tôt cette année, Meta a annoncé qu'elle mettait fin à son programme de vérification des faits par des tiers aux États-Unis – un programme qui permettait aux organisations de vérification des faits d'identifier les fausses allégations et de les étiqueter (et non de les supprimer). L’entreprise a affirmé qu’elle promouvait la liberté d’expression, mais en pratique, elle a supprimé l’un de ses contrôles substantiels contre la désinformation virale. On a ensuite demandé à Trump si Mark Zuckerberg de Meta avait mis fin au programme parce que Trump l'avait menacé ; Atout dit Probablement.

Ces dynamiques font également désormais partie de la politique étrangère américaine ; l’administration Trump fait pression sur les gouvernements étrangers pour qu’ils affaiblissent leurs réglementations technologiques. Le Brésil fournit un exemple clair. Trump a imposé des droits de douane élevés au pays, même si le Brésil importe plus des États-Unis qu’il n’en exporte. Il a cité deux raisons : l’opposition aux poursuites engagées par le Brésil contre son allié politique Jair Bolsonaro – un ancien président faisant face à des accusations liées à l’utilisation des médias sociaux par ses partisans pour diffuser des allégations de fraude électorale après sa défaite en 2022 – et l’opposition aux ordonnances des tribunaux brésiliens exigeant que les sociétés de médias sociaux suppriment certains contenus. L'administration a menacé le juge de la Cour suprême du Brésil, Alexandre de Moraes, de sanctions généralement réservées aux auteurs de violations des droits humains.

D’autres démocraties sont également des cibles. Le Département d'État a suggéré qu'il pourrait restreindre les visas de voyage pour les fonctionnaires de l'Union européenne en raison de réglementations technologiques et il a récemment demandé aux agents consulaires de refuser les visas aux personnes qui ont travaillé dans le domaine de la modération de contenu, de la vérification de la confiance et de la sécurité. (L'IFCN a publié une déclaration s'opposant aux directives.) En Corée du Sud, l'administration s'oppose aux nouvelles réglementations sur les monopoles des plateformes technologiques. Trump a annoncé en septembre qu’il s’opposerait à toute réglementation sur les entreprises technologiques américaines depuis l’étranger. Ces différends diffèrent des conflits commerciaux traditionnels sur les matières premières : l’administration utilise plutôt la pression économique pour empêcher les gouvernements démocratiques de réglementer les entreprises opérant à l’intérieur de leurs frontières.

bryce dallas howard enceinte

Aux États-Unis, le recul des plateformes technologiques en matière de modération et de sécurité génère déjà des conséquences qu’elles n’auraient peut-être pas anticipées. Les marques technologiques ont globalement reçu des notes mitigées lors d'une récente Sondage Axios Harris qui mesurait la réputation de l'entreprise avec des performances exceptionnellement médiocres pour Meta et X. Les candidats politiques aux dernières élections ont fait campagne et ont gagné grâce à des messages anti-tech, notamment Abigail Spanberger de Virginie, qui s'est engagé à freiner les centres de données, Mikie Sherrill du New Jersey promouvant la sécurité des enfants en ligne et Zohran Mamdani de New York critiquant la tarification algorithmique des billets pour les matchs de la Coupe du monde de football.

Un accord bipartisan a même eu lieu dans les couloirs du Congrès, où de nombreuses idées visant à freiner les excès technologiques gagnent le soutien des deux partis. Les sénateurs Josh Hawley et Richard Durbin pensent par exemple que les gens devraient pouvoir poursuivre les sociétés d’IA si leurs produits causent des dommages. Ils ont juste introduit la loi bipartite alignant les incitations pour l’excellence du leadership et l’avancement du développement (AI LEAD) en septembre. Lorsqu'une petite voiture défectueuse se brise et blesse un enfant, les parents peuvent poursuivre le fabricant en justice. Pourquoi l’IA devrait-elle être traitée différemment ? a déclaré Hawley en annonçant la législation.

Que diriez-vous d’exiger des plateformes qu’elles suppriment le porno de vengeance deepfake ? Celle-ci est en fait devenue loi cette année avec la loi TAKE IT DOWN de la sénatrice Amy Klobuchar, co-parrainée par le sénateur républicain Ted Cruz. L'adoption de la loi TAKE IT DOWN est une victoire majeure pour les victimes d'abus en ligne – en offrant aux personnes des protections juridiques et des outils lorsque leurs images intimes, y compris les deepfakes, sont partagées sans leur consentement et en permettant aux forces de l'ordre de demander des comptes aux auteurs, a déclaré Klobuchar. Il entre en vigueur en 2026.

Le sénateur Mark Warner réintroduit sa loi ACCESS en mai pour permettre aux gens de transférer leur réseau de médias sociaux vers une autre plate-forme, ce qui permettra aux plates-formes plus récentes et plus conviviales de rivaliser plus facilement avec les géants bien établis. Hawley et le sénateur Richard Blumenthal l'ont co-parrainé. L’idée est de permettre aux start-ups de rivaliser plus facilement avec les Big Tech en donnant aux utilisateurs plus de contrôle sur leurs propres données.

La recherche sur la dynamique des algorithmes se poursuit également dans des directions nouvelles et convaincantes. Pendant des années, lorsque les gens m’ont demandé quelle était la part de la désinformation sur les réseaux sociaux, j’ai dû répondre, décourageante, qu’il n’existait aucun moyen réel de la mesurer. Mais maintenant, grâce au Projet SIMODS (Indicateurs structurels pour surveiller scientifiquement la désinformation en ligne) Je peux donner une réponse beaucoup plus informative. Le projet a utilisé l’IA pour échantillonner scientifiquement les publications sur les différentes plateformes, puis des évaluateurs humains ont classé les publications pour déterminer la quantité de contenu inexact apparaissant dans l’échantillon. Les résultats ont été fascinants : des pourcentages plus élevés de désinformation ont été trouvés sur TikTok (20 %), Facebook (13 %) et X (13 %), suivis de YouTube (8 %), Instagram (8 %) et LinkedIn (2 %).

Ensuite, les chercheurs ont examiné si la désinformation était plus susceptible de devenir virale. En d’autres termes, les algorithmes ont-ils récompensé le faux contenu plutôt que le vrai contenu ? Il s’avère que les comptes partageant des informations erronées à plusieurs reprises ont suscité plus d’engagement par publication que les comptes crédibles sur toutes les plateformes à l’exception de LinkedIn. Les taux de désinformation virale étaient les plus élevés sur YouTube et Facebook, où les mauvais acteurs étaient capables de générer respectivement huit et sept fois un engagement normal ; c'était cinq fois plus probable sur Instagram et X et deux fois plus probable sur TikTok.

Les chercheurs n'ont été financés que pour étudier quatre pays d'Europe (France, Espagne, Pologne, Slovaquie), mais la méthode pourrait facilement être répétée pour les États-Unis et les implications sont importantes et méritent une étude plus approfondie. En regardant les chiffres ci-dessus, je me demande si une plate-forme comme TikTok est plus permissive en permettant aux gens de publier du contenu inexact, mais fait un bien meilleur travail que ses concurrents pour l'empêcher de devenir viral. Il y a également des implications à découvrir à propos de LinkedIn : la façon dont il favorise les personnes réelles ou les entreprises publiant sous leur propre nom permet-il des publications plus précises ? Cela semble certainement être le cas.

Le fait est que ces entreprises peuvent s’améliorer et que des chercheurs indépendants peuvent contribuer à suggérer des réformes dans l’intérêt des utilisateurs quotidiens. Dernièrement, les plateformes ont vendu des données aux courtiers en données des annonceurs et aux systèmes d’intelligence artificielle tout en restreignant l’accès des chercheurs à ces mêmes données. Pour inverser cette tendance, le Knight-Georgetown Institute a lancé un projet appelé Un meilleur accès auquel j'ai contribué. Le projet établit des normes multiplateformes uniformes pour permettre aux chercheurs d'accéder à des publications publiques de haut niveau. Avec un meilleur accès, les chercheurs pourraient s’attaquer à toutes sortes de projets, comme étudier la manière dont les escroqueries en matière de soins de santé se propagent ou mesurer si les plateformes appliquent réellement leurs propres politiques de la même manière. Ces études sont presque impossibles aujourd’hui, mais elles sont cruciales pour la responsabilisation.

wil willis wiki

Enfin, même si Meta a arrêté le programme de vérification des faits aux États-Unis, il semble qu'il se poursuive dans le reste du monde. Les efforts réglementaires en Europe, au Brésil et en Corée du Sud ne vont pas disparaître ; les propositions reposent sur l’idée selon laquelle la fraude et les canulars ne peuvent être combattus efficacement qu’en incitant les gens à être plus prudents et à réfléchir avant de partager. Les actes individuels de prévention ne peuvent pas s’adapter à la puissance des algorithmes Internet.

Tous ces efforts suggèrent un fort désir de changement significatif afin que nous ne nous dirigeions pas vers un monde indifférent à la réalité elle-même – un monde où les parents doivent se demander si c’est vraiment leur enfant qui appelle à l’aide, où le clergé passe autant de temps à démystifier les versions IA d’eux-mêmes qu’à servir leur troupeau ou où un retraité solitaire peut être attiré vers la mort par un chatbot.

La recherche européenne a révélé quelque chose de crucial : leur étude suggère que les choix de conception sont extrêmement importants. En exigeant des identités réelles et en privilégiant des profils professionnels authentiques, LinkedIn a par exemple créé un environnement où l'exactitude est une norme. Quelles autres leçons pourrions-nous tirer d’une étude plus approfondie ?

Internet n’est pas brisé par nature. Cette tendance est rompue par des choix qui privilégient l’engagement viral plutôt que l’exactitude et qui récompensent les mauvais acteurs anonymes qui considèrent la désinformation comme un coût acceptable pour faire des affaires. Différentes décisions pourraient produire des résultats radicalement différents. Ce ne sont pas des problèmes insolubles. Ce sont des choix et nous pouvons insister pour en choisir de meilleurs.