Les vérificateurs de faits britanniques envoient leur IA pour aider les Américains à couvrir les élections

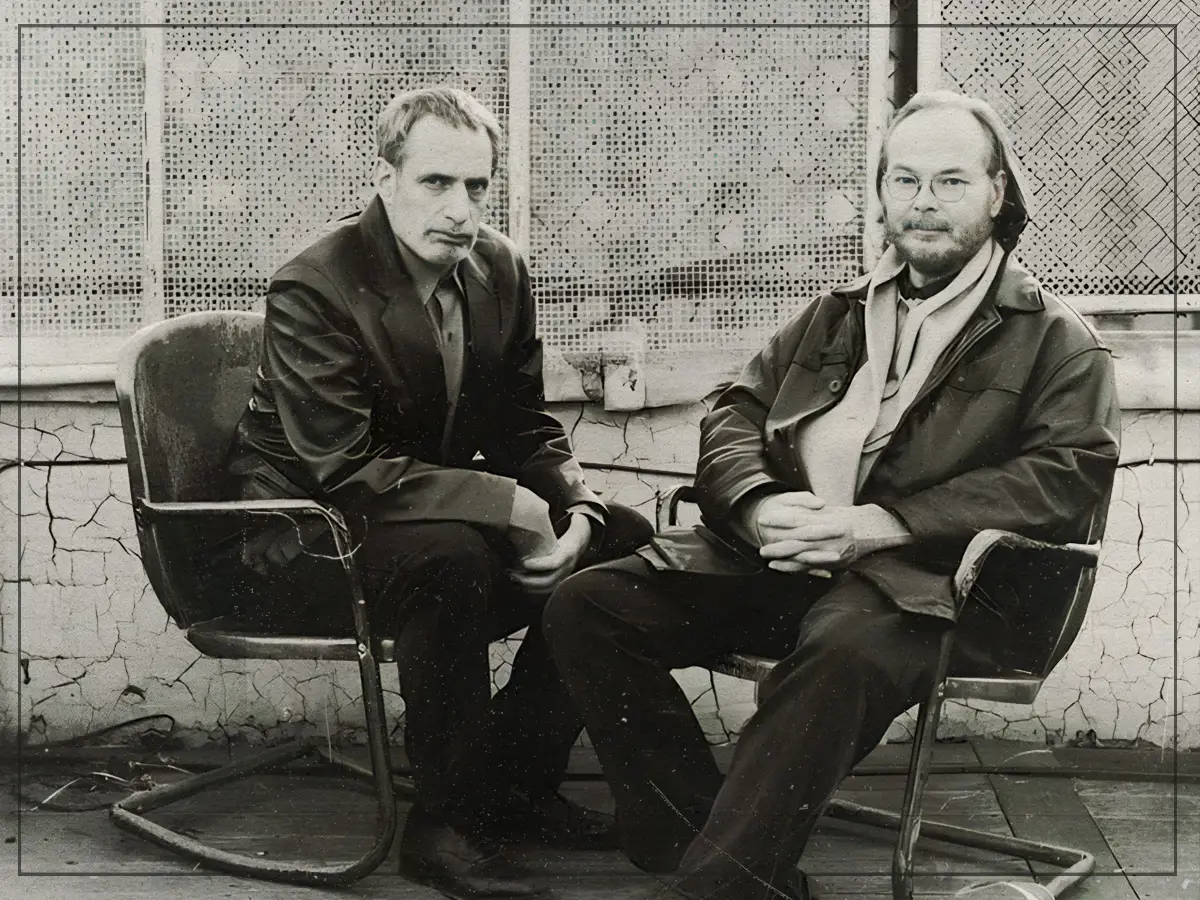

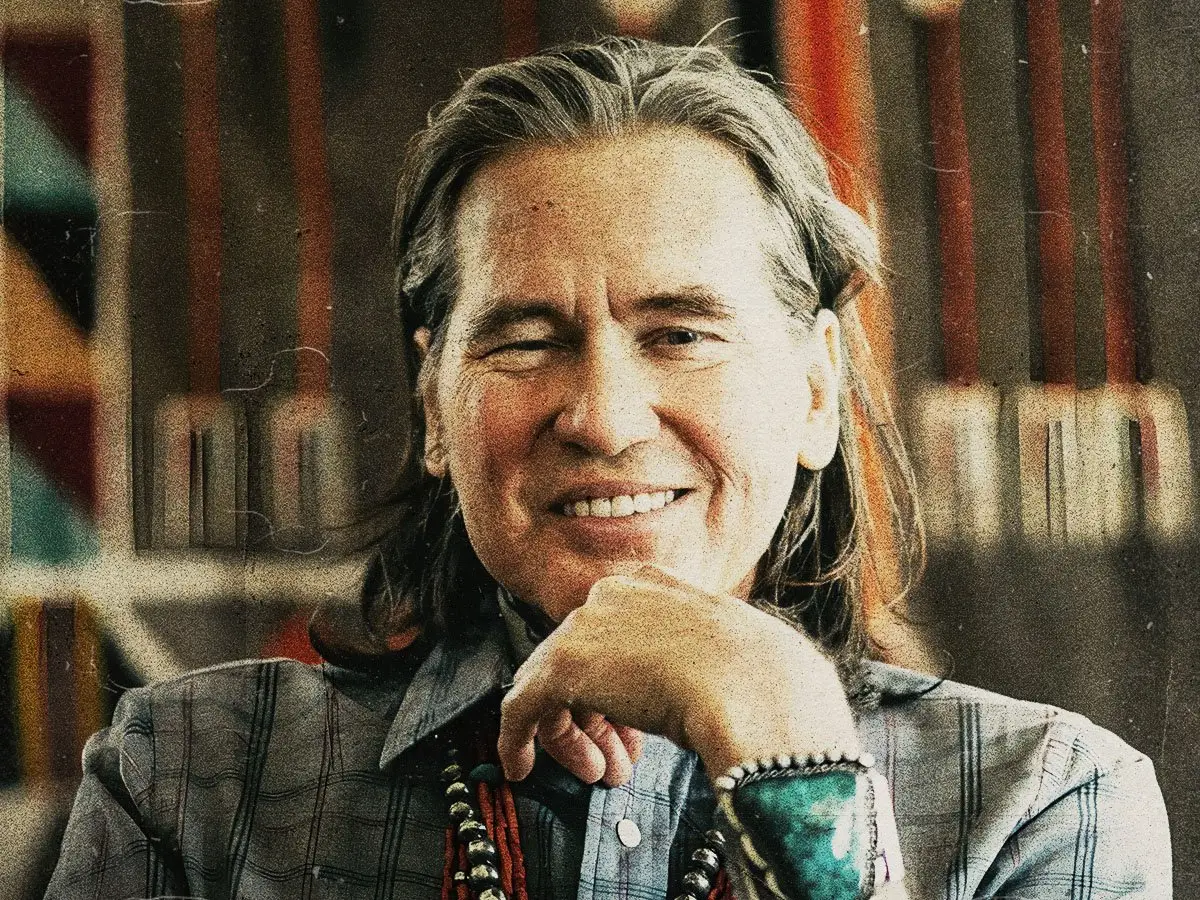

De gauche à droite : Kate Wilkinson, responsable de l'IA chez Full Fact, Andy Dudfield, chef de produit principal, et David Corney, scientifique principal des données. (Avec l'aimable autorisation de Full Fact)

De gauche à droite : Kate Wilkinson, responsable de l'IA chez Full Fact, Andy Dudfield, chef de produit principal, et David Corney, scientifique principal des données. (Avec l'aimable autorisation de Full Fact)Dans un modeste bureau près de London Bridge, une petite équipe d’ingénieurs et de vérificateurs de faits a passé une décennie à perfectionner les outils et les modèles d’IA pour faire ce que la plupart des journalistes ne peuvent plus faire : suivre le rythme. Le système lit les titres, transcrit les émissions et analyse les médias sociaux à la recherche d’affirmations méritant d’être vérifiées. Il identifie les personnes les plus susceptibles d’induire en erreur ou de causer un préjudice.

La technologie développée par Full Fact, la principale organisation caritative britannique de vérification des faits, traverse l’Atlantique. À la veille des élections américaines de mi-mandat de 2026, dont de nombreux experts en désinformation s'attendent à ce qu'elles soient définies par des mensonges créés par l'IA, Full Fact invite les rédactions américaines à tester ses outils dans le cadre de sa recherche de financement pour étendre son travail aux États-Unis.

Fondée en 2009, Full Fact a commencé à expérimenter la technologie bien avant que les grands modèles linguistiques n'attirent l'attention du monde entier. En 2016, ses dirigeants ont réalisé que les vérificateurs humains des faits ne pouvaient plus surveiller chaque émission ou plateforme à la recherche d’affirmations douteuses sur des questions d’intérêt public. Lorsqu'Andy Dudfield a rejoint l'organisation en 2019 pour diriger les travaux sur l'IA, il a trouvé une petite équipe explorant déjà comment l’automatisation pourrait aider.

trey kulley majors

La technologie de Full Fact est née des premiers traitements du langage naturel avant les modèles génératifs actuels. L’équipe a commencé par former des systèmes pour identifier les déclarations vérifiables et les faire correspondre aux vérifications des faits existantes. En 2019, les ingénieurs ont peaufiné le BERT de Google – un modèle conçu pour comprendre le langage plutôt que de le générer – pour étiqueter les types de revendications dans les actualités et les réseaux sociaux.

Avec des dizaines de milliers d'annotations humaines, le modèle a appris à trier de vastes flux de texte, traitant plus de 300 000 phrases par jour et signalant les nouvelles affirmations qui réapparaissaient dans des formulations différentes. Au cours des deux dernières années, des modèles génératifs plus vastes ont été ajoutés pour estimer les dommages potentiels et détecter les versions paraphrasées qui manqueraient aux anciens systèmes. Les nouveaux systèmes font apparaître et regroupent des informations erronées probablement préjudiciables et les vérificateurs des faits décident des éléments à enquêter et à publier.

Les utilisateurs accèdent aux outils via un tableau de bord Web qui présente les réclamations provenant des podcasts d'actualités sur les réseaux sociaux, des vidéos et de la radio. L'interface renvoie à des clips ou des publications originaux et permet aux équipes d'effectuer une recherche par sujet ou par intervenant pour voir où les affirmations sont apparues et recevoir des alertes lorsque des déclarations démystifiées refont surface. S'il est activé, le système peut donner la priorité aux allégations potentiellement préjudiciables afin que les éditeurs puissent décider sur quoi travailler en premier.

Tout ce que nous avons construit dans la technologie l'est dans la perspective d'être construit par des vérificateurs de faits pour des vérificateurs de faits, m'a dit Dudfield. Nous n’essayions pas de déterminer ce que la technologie pourrait faire, ce serait cool. Nous essayions de découvrir les problèmes réels que nous rencontrions avec la vérification des faits et de voir si la technologie pouvait nous aider.

Cette distinction a façonné Full Fact AI, désormais une équipe de huit personnes au centre du travail de l’association. Le système analyse le préjudice potentiel d’une réclamation en évaluant à quel point elle est erronée, à quel point elle semble crédible et quelle est la probabilité qu’elle incite les gens à agir en conséquence.

Le modèle du préjudice s’appuie sur les recherches de Peter Cunliffe-Jones, fondateur d’Africa Check et auteur de Fake News : What’s the Harm ? Dans ce livre publié par University of Westminster Press, Cunliffe-Jones explique comment les mensonges peuvent déclencher des conséquences mesurables – depuis les attaques de la foule contre les agents de santé lors de l’épidémie d’Ebola en 2014 jusqu’aux lynchages en Inde alimentés par les canulars WhatsApp concernant les ravisseurs d’enfants. Entre 2021 et 2025, il a développé un modèle pour prédire quelles fausses déclarations étaient les plus susceptibles d’entraîner un préjudice réel.

Les vérificateurs des faits doivent se concentrer sur ce qui est le plus susceptible de causer un réel préjudice, et pas seulement sur ce qui ne va pas, m'a dit Cunliffe-Jones dans un e-mail. Le cadre d’évaluation des préjudices de Full Fact applique ce modèle à grande échelle, aidant les vérificateurs de faits à diriger des ressources limitées là où elles comptent le plus.

Les outils ont été utilisés par plus de 40 organisations de vérification des faits dans plus de 30 pays, notamment lors de l’élection présidentielle nigériane de 2023, où les vérificateurs de faits les ont utilisés pour suivre et démystifier les affirmations virales en temps réel . Le système est une co-intelligence entre l’humain et la machine, a déclaré Kate Wilkinson, chef de produit senior de Full Fact, qui dirige la sensibilisation auprès des salles de rédaction américaines.

Nos outils n'ont pas été conçus pour remplacer les vérificateurs de faits, a déclaré Wilkinson. Ils éliminent la tâche très coûteuse en temps et en ressources de la surveillance des médias.

Full Fact a commencé à inviter les bureaux de vérification des faits américains, des équipes locales aux réseaux nationaux, à tester ses outils d'IA avant les élections de l'année prochaine. Wilkinson a qualifié le timing de approprié et a déclaré que la plate-forme pourrait aider les salles de rédaction à gérer les revendications électorales à grande échelle sans avoir recours à du personnel d'ingénierie. Le déploiement comprend des licences subventionnées et de courtes sessions d'intégration pour aider les équipes à intégrer rapidement les outils dans leur travail quotidien.

Cette décision intervient alors que de nombreuses salles de rédaction indépendantes et à but non lucratif sont confrontées à des difficultés financières croissantes tout en expérimentant comment l'IA peut les aider à mieux servir leur public. Aux États-Unis Meta terminé son programme de vérification des faits par des tiers en janvier a forcé plusieurs médias à réduire leurs activités et a incité près d'un tiers des organisations accréditées par l'International Fact-Checking Network à fermer leurs portes.

Il y a deux semaines, Full Fact a révélé que Google avait retiré son soutien de longue date au travail de l’organisation caritative en matière d’IA. L'organisation a déclaré avoir reçu plus d'un million de livres sterling de Google l'année dernière, soit directement, soit par l'intermédiaire de fonds connexes, qui ont tous été interrompus.

Dudfield a qualifié la perte d'importante mais pas d'insurmontable. La technologie n’est pas quelque chose que nous faisons à côté chez Full Fact, a-t-il déclaré. C’est au cœur de ce que nous faisons.

Dans un communiqué, le directeur général de Chris Morris Full Fact a déclaré que l'organisme caritatif recentrait de toute urgence sa collecte de fonds tout en restant indépendant. Morris, le premier vérificateur de faits à l'antenne de la BBC, a également critiqué ce qu'il a décrit comme un refroidissement politique de la part de la Silicon Valley. Nous pensons que les décisions de Google et celles d’autres grandes entreprises technologiques américaines sont influencées par le besoin perçu de plaire à l’administration américaine actuelle. a écrit . Les faits complets seront toujours clairs : les faits vérifiables sont importants et les grandes sociétés Internet ont des responsabilités lorsqu'il s'agit de freiner la propagation de fausses informations préjudiciables.

Les réductions de financement font suite à un recul plus large des grandes entreprises technologiques de soutenir la vérification des faits à l’échelle mondiale. Dudfield a déclaré que l’environnement changeant a renforcé la mission de son équipe consistant à utiliser la technologie pour soutenir une vérification indépendante. Nous continuerons à utiliser la technologie pour soutenir la vérification des faits, car nous pensons que c’est là que nous pouvons faire la plus grande différence, a-t-il déclaré.

L’expansion de Full Fact arrive à un moment charnière pour la vérification des faits, a déclaré Lucas Graves, professeur de journalisme à l’Université du Wisconsin-Madison et auteur de Décider de ce qui est vrai : l’essor de la vérification des faits politiques dans le journalisme américain.

De nombreuses expérimentations en matière d’IA se déroulent dans le paysage médiatique américain, dans les salles de rédaction, grandes et petites, a-t-il déclaré. Mais ce que propose Full Fact, c’est une plate-forme spécialement conçue et développée sur près d’une décennie pour suivre et hiérarchiser la désinformation – un domaine dans lequel la plupart des rédactions n’ont pas beaucoup d’expérience.

Graves a qualifié cette expansion de opportune, ajoutant que la menace de la désinformation en ligne évolue rapidement alors que les ressources des salles de rédaction continuent de diminuer.

Malgré l’évolution politique et le déclin du soutien à l’industrie, Dudfield a déclaré que l’objectif n’avait pas changé. Nous vérifions les faits. Nous vérifions les faits, a-t-il dit. Le travail visant à dénoncer les mensonges reste essentiel, a-t-il ajouté, même si les pressions sur les journalistes indépendants s’accentuent. L’alternative, selon lui, coûterait beaucoup plus cher.