Comment repérer de fausses images de guerre après les frappes américaines contre des sites nucléaires iraniens

Les manifestants portent des pancartes et brandissent un drapeau iranien alors qu'ils se rassemblent devant la Maison Blanche le dimanche 22 2025 juin à Washington pour protester contre l'attaque militaire américaine sur trois sites en Iran tôt dimanche. (Photo AP/José Luis Magana)

Les manifestants portent des pancartes et brandissent un drapeau iranien alors qu'ils se rassemblent devant la Maison Blanche le dimanche 22 2025 juin à Washington pour protester contre l'attaque militaire américaine sur trois sites en Iran tôt dimanche. (Photo AP/José Luis Magana)Des images et des vidéos d’explosions, d’incendies, de manifestations et d’armes sont devenues virales après les attaques américaines du 21 juin contre trois sites nucléaires iraniens – mais beaucoup d’entre elles ne montraient pas ce qui se passait réellement.

Au lieu de cela, ils ont été générés par l’intelligence artificielle, sortis de leur contexte ou enregistrés à partir de jeux vidéo ou de simulateurs de vol. Beaucoup d’entre eux étaient partagés par des comptes X cochés en bleu qui étaient auparavant associés à des comptes appartenant à des personnes ou à des organisations aux identités vérifiées. (Maintenant, ils peuvent être achetés.)

Il peut être difficile de savoir au premier coup d’œil sur les plateformes de médias sociaux si les légendes alarmistes correspondent réellement à la photo ou à la vidéo que vous voyez ; Parfois, les programmes de notes communautaires ajoutent du contexte, mais parfois ils ne le font pas .

PolitiFact a vérifié certaines des images et vidéos trompeuses sur l’attaque américaine et sa réaction. Voici un guide de ce qu’il faut éviter et des conseils sur la façon de vérifier les images de conflit.

Les images générées par l'IA contiennent souvent des incohérences visuelles

Un compte à chèque bleu sur X appelé Ukraine Front Line a publié une vidéo 22 juin qui montre un éclair frappant un panache de fumée éclatant dans une brume ardente. La légende mettait en garde contre une guerre nucléaire : S'il vous plaît, faites attention à la foudre ! C’est le signe le plus sûr que l’explosion était bien nucléaire.

Mais la vidéo ne montre pas un événement réel. Il a été téléchargé Le 18 juin sur YouTube avec la légende ai vidéo. Le biographie du compte lit Toutes les vidéos de cette chaîne sont produites avec l'intelligence artificielle.

Certains modèles d'IA générative permettent aux utilisateurs d'écrire des invites pour générer des vidéos réalistes et les résultats deviennent de plus en plus sophistiqués.

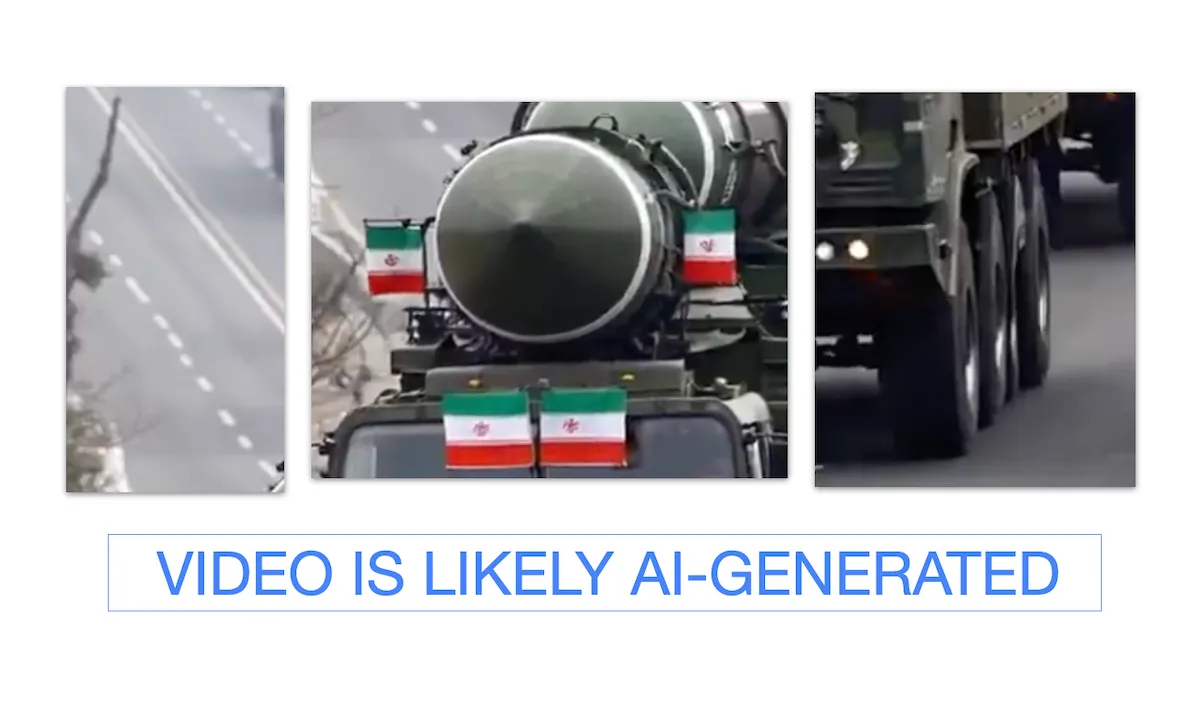

Mais ils ne sont pas parfaits et un examen attentif des vidéos révèle souvent des incohérences visuelles. Une vidéo sous-titré Se préparer à l'attaque (de ce soir) montrait des camions arborant des drapeaux iraniens et transportant des missiles. Un examen plus approfondi a montré que les lignes sur la route étaient inégales, qu'un pneu du deuxième camion semblait avoir un morceau arraché et que les caractères sur les drapeaux ne correspondaient pas non plus au véritable drapeau iranien.

(Captures d'écran/X)

alejandra genevieve oaziaza enfants

Hany Farid, professeur à l'UC Berkeley spécialisé dans la criminalistique numérique a écrit sur LinkedIn que de nombreuses vidéos générées par l'IA durent souvent huit secondes ou moins ou sont composées de clips de huit secondes montés ensemble. C'est parce que Google, je vois 3 un modèle texte-vidéo a une limite de huit secondes. Certaines vidéos comportent des filigranes visibles, mais les utilisateurs peuvent les rogner.

Les médias déformés ont toujours été plus important que les images de l’IA lors des événements d’actualité. Mais pendant cette guerre, les comptes pro-israéliens et pro-iraniens ont partagé des images d’IA. Emmanuelle Saliba, directrice des enquêtes de la société de criminalistique numérique Get Real Labs, a déclaré BBC Vérifier c’était la première fois que nous voyions l’IA générative être utilisée à grande échelle lors d’un conflit.

Les désinformateurs continuent de partager d’anciennes images et vidéos hors contexte

Parallèlement à l’utilisation croissante de l’IA par les désinformateurs, les images et vidéos partagées dans un contexte inapproprié ne manquent pas.

Des manifestations de masse éclatent à travers l'Amérique alors que les citoyens descendent dans la rue avec indignation après le lancement de l'attaque américaine contre l'Iran. Post X du 22 juin lire. Mais la vidéo a été téléchargée 14 juin le jour des manifestations contre les rois dans tout le pays.

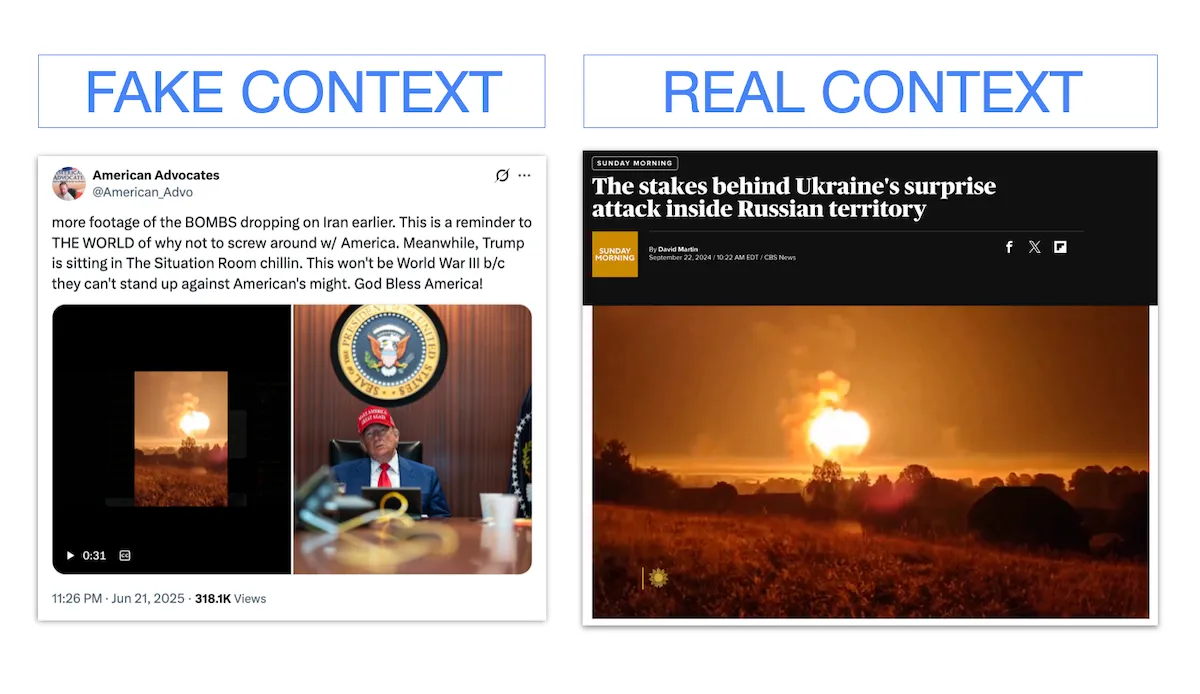

Une autre vidéo X partagée la nuit des attaques américaines montrait un grand panache de feu et de fumée. D'autres images des bombes larguées sur l'Iran ont été lues plus tôt dans le légende vidéo . Mais c’est faux ; la vidéo vient d'un 2024 Attaque ukrainienne contre la Russie .

(Captures d'écran/X CBS News)

Une recherche d'image inversée peut révéler si une vidéo a déjà été mise en ligne et quel était le contexte d'origine. Des outils tels que Google Lens et TinEye peuvent montrer où les images ou les vidéos ont été partagées sur les plateformes qui les ont publiées et quand la première publication a été publiée. Les légendes des images publiées par les médias indiqueront probablement quand et où elles ont été prises.

Des séquences de jeux vidéo tirées des manuels de jeux de conflits antérieurs

Les images enregistrées à partir de simulateurs de vol et de jeux vidéo militaires dénaturent également le conflit.

C'est le B2 Spirit Stealth Bomber qui décolle en Californie ! lire un Post X du 21 juin par un compte chèque bleu avant l'attaque contre l'Iran.

Sauf que ce n’était pas un vrai bombardier B2. La vérification du filigrane de la vidéo mène à un compte TikTok qui a publié la vidéo 15 mai avec le hashtag #microsoftflightsimulator un jeu de simulation disponible sur Xbox.

Le gameplay du jeu vidéo Arma est également susceptible d’être utilisé à mauvais escient pendant un conflit armé . Les allégations vérifiées par PolitiFact qui ont utilisé des images d'Arma pendant la Guerre Ukraine-Russie et le Guerre Israël-Hamas .

Les recherches par mots clés sur les plateformes vidéo telles que YouTube peuvent indiquer si les vidéos correspondent aux séquences de jeux vidéo précédemment mises en ligne.

Des moyens simples d'analyser la fiabilité des comptes

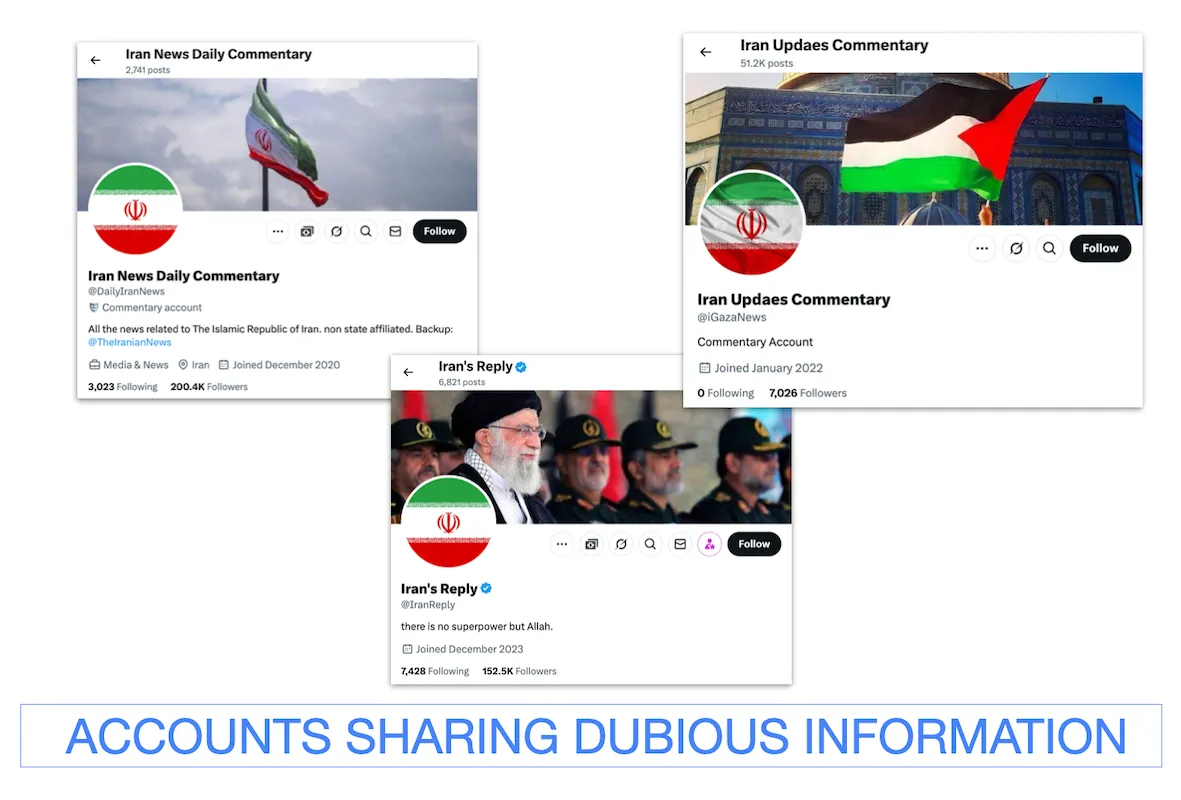

Vérifier le profil et la biographie d’un compte révélera souvent s’il est crédible ou non. De nombreuses affirmations fausses et trompeuses provenaient de comptes dont la photo de profil et les noms d’affichage arboraient le drapeau iranien et qui pouvaient être confondus avec des informations légitimes.

Ces comptes incluent Iran Updaes Commentary (faute de frappe incluse) et Iran News Daily Commentary. Un autre compte – avec une coche bleue – s’appelle Iran’s Reply.

(Captures d'écran/X)

annie bakesMais ceux-ci ne sont pas affiliés au gouvernement iranien ni à aucune source crédible. PolitiFact a constaté que messages sur ces comptes gagner des centaines de milliers, voire des millions de vues, mais contiennent du contenu de mauvaise qualité tel que des images générées par l'IA. Cette vérification des faits était à l'origine publié par PolitiFact qui fait partie de l'Institut Poynter. Voir les sources de cette vérification des faits ici .